Ormai si sente spesso parlare di servizi Cloud, una storia che i più nostalgici chiamavano, in tempi non sospetti, Outsourcing. Sta prendendo certamente piede, ha indubbi e tangibili vantaggi e si vende molto facilmente grazie alla tipologia di vendita tipica delle diete caratteristiche di chi soffre di gastrite come me, ovvero "pagami poco, ma pagami spesso" (che poi il costo al cliente finale sia davvero più conveniente di un investimento iniziale, questo è tutto da vedere e nella maggior parte dei casi facilmente si può evincere come non sia così).

Si narra che l'Imperatore della Cina, preso dal nuovo gioco degli scacchi, volle ricompensare il suo inventore chiedendogli cosa avesse voluto in dono. "solo un chicco di riso nella prima casella, due chicchi nella seconda, quattro nella terza e così via, vostra maestà", rispose l'inventore degli scacchi. Stupito l'Imperatore rispose "tutto qui?", acconsentendo e pensando fosse una richiesta del tutto irrisoria. Arrivati a metà scacchiera, il conto riportava quasi 4 miliardi di chicchi di riso, ovvero una risaia intera. A fine scacchiera l'imperatore, per mantenere la sua parola, non potette fare altro che cedere il suo impero.

Questo simpatico aneddoto introduce il punto 1.

I costi

Apparentemente, 9 euro al mese per un office non sono tanti. In un anno diventano 108, in 20 mesi mi sono ripagato una licenza permanente e tipicamente un PC con office dura in media 5 anni portandomi ad un costo di 540 euro (l'office, in buona sostanza, mi è costato 3 volte).

Possiamo fare innumerevoli considerazioni su quanto office 365 offra molti più servizi (offra? tolga?) di una licenza permanente e limitata ad una singola macchina. Ed io sono d'accordo. Ma francamente ad un utente serve l'office per lavorare sul suo foglio excel o word... punto.

E' solo un esempio, non è mia intenzione prendere il caso specifico di office 365, ma non è inusuale che i costi della stragrande maggioranza dei servizi in cloud appaiano piccoli e frammentati, ma poi sommati e attualizzati ad una media ed una aspettativa di vita di un servizio, diventino considerevoli.

Altro aspetto è il concetto di "espansione". Hai a disposizione 100, la tua attività è cresciuta, auguri e felicitazioni, adesso mi devi 100+10. Spesso però, quando contestualizziamo questo aspetto, siamo più che felici di pagare qualcosa in seguito ad un incremento della nostra attività. Ma è davvero così? I dati crescono con l'aumentare dei nostri introiti? Non mi sembra. I dati crescono perlopiù con il passare del tempo, e così ci porteremo dietro un "carrozzone" sempre più ingombrante.

Dove sono i miei dati?

Bella domanda. Alcuni dichiarano esplicitamente dove si trovano i dati. Altri, i più grandi, semplicemente li sparpagliano tra i propri datacenter. I miei dati, sostanzialmente, non sono più ben localizzati, confinati, definiti. Al contrario, diventano spesso un fantastico puzzle le cui sembianze ed i cui contorni sono del tutto ignoti.

Ecco qualche esempio:

"I dati personali raccolti da Google possono essere archiviati ed elaborati negli Stati Uniti d'America o in qualsiasi altro Paese in cui Google è presente attraverso proprie strutture o propri agenti.". "Un Cliente residente in un Paese al di fuori degli Stati Uniti accetta inoltre di rispettare tutte le normative locali in materia di condotta online e contenuti accettabili, incluse le leggi che disciplinano l'esportazione e la riesportazione di dati verso o dagli Stati Uniti e il Paese in questione."

Non sottovalutiamo che, dopo il Patriot Act, c'è una certa "goliardia" nel concetto di privacy.

Indubbiamente datacenter più piccoli e specializzati (ad esempio il classico esempio di "gestionale in cloud") offrono più vantaggi sotto questo aspetto.

Non ultimo, è bene ricordare che l'art.25 comma 1 della direttiva 96/46/CE e l'art.45 del Codice Privacy impongono serie restrizioni sulla trasferibilità dei dati fuori dalla Comunità Europea, anche temporaneamente.

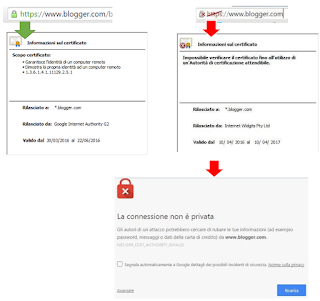

I miei dati sono al sicuro?

Quando la nuvola diventa temporalesca, si scappa. C'è poco da fare, se i dati vengono persi, i fattacci sono i tuoi. Non c'è provider che non ti faccia firmare la clausola di esclusione di responsabilità. E non c'è datacenter che non abbia mai incontrato problemi di Data Loss.

Ecco qualche policy simpatica che nessuno legge:

LIMITAZIONE DI RESPONSABILITÀ

L'UTENTE RICONOSCE E ACCETTA ESPRESSAMENTE CHE GOOGLE E I PARTNER NON SARANNO RESPONSABILI NEI SUOI CONFRONTI PER QUALSIASI DANNO DIRETTO, INDIRETTO, INCIDENTALE, SPECIALE, CONSEQUENZIALE O ESEMPLARE, INCLUSI, A TITOLO ESEMPLIFICATIVO, I DANNI PER LA PERDITA DI PROFITTI, AVVIAMENTO, USO, DATI O ALTRE PERDITE INTANGIBILI (ANCHE SE GOOGLE O I PARTNER SONO STATI AVVISATI DELLA POSSIBILITÀ DI TALI DANNI.) DERIVANTI DA: (i) USO O IMPOSSIBILITÀ DI UTILIZZARE I SERVIZI GOOGLE, (ii) COSTO PER IL PROCACCIAMENTO DI BENI O SERVIZI SOSTITUTIVI RISULTANTI DA MERCI, DATI, INFORMAZIONI O SERVIZI ACQUISTATI O OTTENUTI O DA MESSAGGI RICEVUTI O TRANSAZIONI CONCLUSE TRAMITE O DAI SERVIZI GOOGLE, (iii) ACCESSI NON AUTORIZZATI O ALTERAZIONI DELLE TRASMISSIONI O DEI DATI DELL'UTENTE, (IV) DICHIARAZIONI O CONDOTTA DI QUALSIASI TERZA PARTE SUI SERVIZI GOOGLE O (v) QUALSIASI ALTRO ASPETTO CORRELATO AI SERVIZI GOOGLE.

Ma troviamo casi simili anche altrove:

Insomma, i backup non sono un opzional, anche se l'infrastruttura non è la tua. E la cosa, paradossalmente (avevamo scelto il cloud proprio per non occuparci della manutenzione dei nostri dati), si complica parecchio quando i sistemi non sono i tuoi.

Rivoglio indietro i miei dati!

Una volta nella nuvola, riavere indietro i propri dati non è sempre semplice.

Per trasferire il software e i servizi a governi di paesi sottoposti a

embargo o ad alcune parti verso le quali esiste il divieto di esportazione, il licenziatario dovrà ricevere

l’autorizzazione del governo degli Stati Uniti. Per ulteriori informazioni, il licenziatario potrà leggere il

documento treasury.gov/resource-center/Documents/soc_net.pdf. Inoltre, i servizi a pagamento sono

soggetti alle leggi e ai regolamenti vigenti negli Stati Uniti in materia di controllo dell’esportazione. Il

licenziatario dovrà conformarsi a tali leggi e regolamenti. Queste leggi includono limitazioni circa le

destinazioni, gli utenti finali e l’utilizzo finale. Per ulteriori informazioni, il licenziatario potrà visitare la

pagina www.microsoft.com/exporting.

Ho appreso ieri che Google stessa pone pesanti limitazioni sul recupero dei tuoi dati se vuoi cessare il servizio. Restrizioni che rendono estremamente difficoltoso il passaggio altrove.

Conclusione

Voglio essere chiaro: io non sono contro il cloud. Ha aperto scenari importanti, vero, ma spesso è stata una forzatura e le aziende hanno sottoscritto contratti che definire "alla leggera" è un eufemismo. Troppo spesso ci si dimentica che i dati di un'azienda sono un patrimonio inestimabile, più degli automezzi, più degli immobili e spesso persino più di ogni altra cosa. Quando i dati della contabilità o i dati dei CAD di produzione vengono persi, ci si rende conto del vero valore di quelle informazioni. Un'azienda non compra alla leggera un immobile, perchè dovrebbe dare i propri dati così superficialmente? Senza valutare poi i rischi legati all'assenza di connettività e ai danni che questa può arrecare alla produttività.

Il cloud è un fenomeno interessante, ma non sempre. Il cloud privato, ad esempio, può essere una strada ibrida e che può preservare la riservatezza ed il controllo del nostro patrimonio informatico, pur erogando tutti i servizi estremamente comodi ed interessanti tipici del cloud.

Si rimanda ad un utile documento informativo redatto dal Garante della Privacy che riporta un interessante e condiviso decalogo che andrebbe consultato prima di decidere di spostare i propri dati nella nuvola. Reperibile

QUI.